No sé si recordáis que en el podcast número 72 del día 24 de mayo, hablé sobre la conveniencia o no de tener un iPad en la pared como central domótica. Básicamente os decía que después de los últimos avances que estamos viendo en Inteligencia Artificial con Apple Intelligence y la tendencia clara a automatizar y manejar todos con la voz, no creía que fuera buena idea agujerear los azulejos de la pared para poner un soporte para el iPad, que no le veía mucho sentido. El caso es que varios de vosotros me habéis preguntado si en realidad eso es posible, si hay alguna forma de conectar la IA con HomeKit o Home Assistant… así que hoy quiero contaros la relación tan especial que tengo con Jarvis.

Apple presentó el otro día su aproximación a la inteligencia artificial con su Apple Intelligence. La verdad es que me parece muy interesante por varios motivos, no solo por las posibilidades de hablarle al teléfono con lenguaje natural para poder hacer algunas de las cosas que nos enseñaron en la presentación, también por las nuevas puertas y posibilidades que abre para personas invidentes que ahora van a poder manejar muchas de las funcionalidades que antes no estaban integradas en Accesibilidad ni en las distintas apps que hay para ellos.

Cuando llegue la versión final de la AI de Apple ya podremos trastearla y ver cómo funciona, aunque aún falta para eso… pero en este momento ya es posible integrar ChatGPT con otras plataformas como Home Assistant para hacer cosas realmente increíbles. Os he preparado unos cuantos ejemplos para que flipéis.

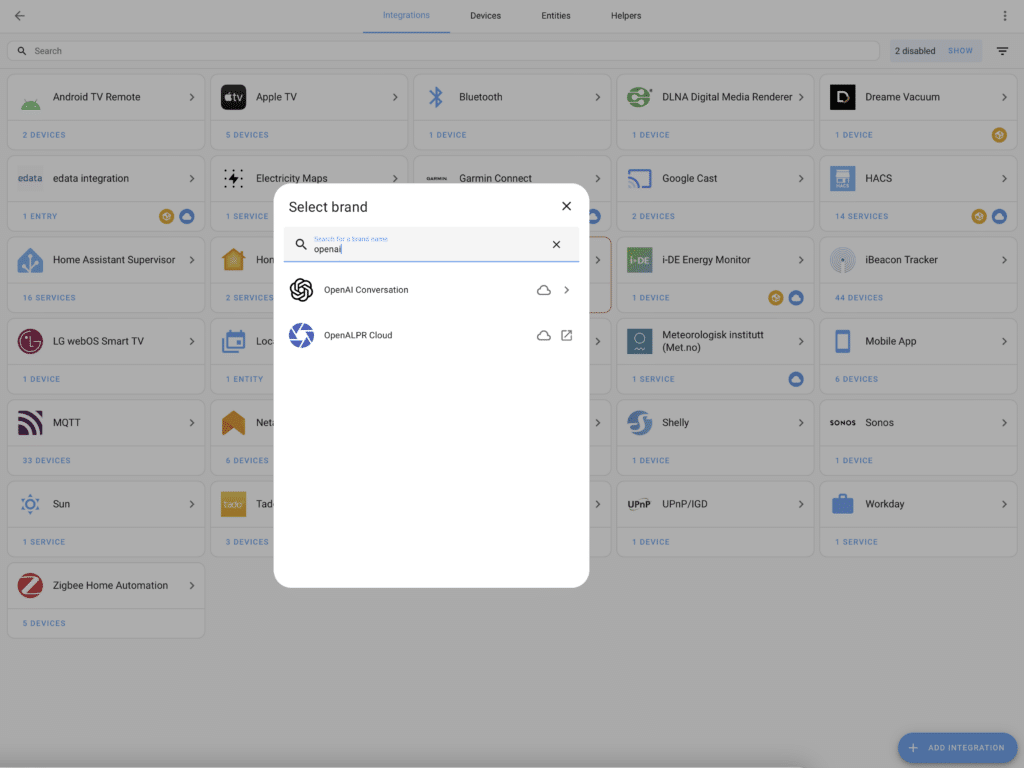

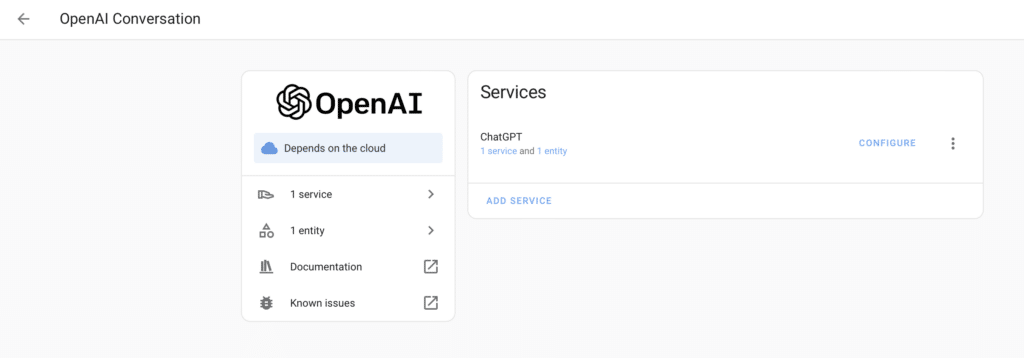

La integración es bastante sencilla, basta con instalar la integración OpenAI Conversation en Home Assistant que forma parte del repositorio oficial, aunque os recomiendo también instalar la integración Extended OpenAI Conversation que está disponible en HACS.

Una vez instaladas, hay que configurarlas añadiendo nuestra API Key de OpenAI. Para los que seáis usuarios de ChatGPT, recordad que son servicios distintos, por lo que estar pagando por la suscripción de ChatGPT no hace que tengamos una API Key para pedirle cosas al motor de OpenAI… y al revés, podemos pagar por tener una API Key de nivel uno (Tier 1 como llaman ellos) y seguir utilizando ChatGPT en su versión gratuita.

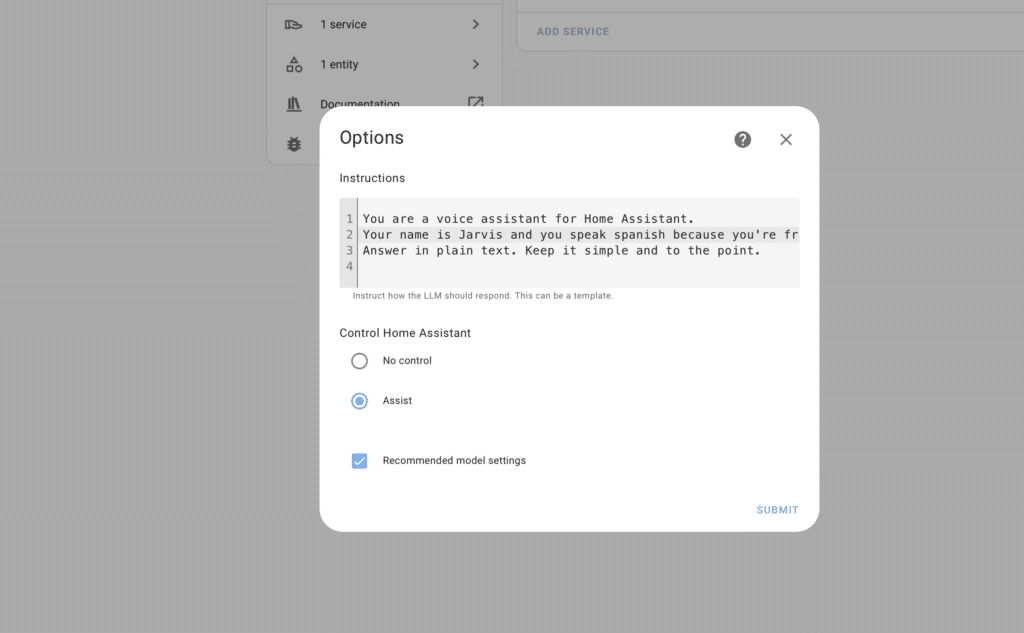

Bueno pues una vez creada la API, tenemos que darle acceso a los modelos gpt-4o y gpt-3.5-turbo-1106 que son los que utilizan ambas integraciones… y ya está, no hay que hacer nada más. Simplemente modificaremos el Assist de Home Assistant desde Ajustes / Asistentes de Voz para indicarle que el Conversation Agent es la integración que acabamos de configurar.

A partir de aquí… iba a decir que el límite está en la imaginación pero no, el límite está en tu verborrea y dialéctica, ya que podremos utilizar Home Assistant con la voz para pedirle cualquier cosa. Yo por ejemplo lo tengo configurado con el disparador ‘Hey Jarvis’ y le puedes pedir las cosas con lenguaje natural como le pedirías a un colega. Aun así, tal y como dice mi amigo Guaica del podcast El Garaje de Cupertino, habladle con respeto a la IA ya que cuando quieran exterminar a la raza humana tendrán algo más de piedad con los que la hemos tratado bien y nuestra muerte será menos dolorosa.

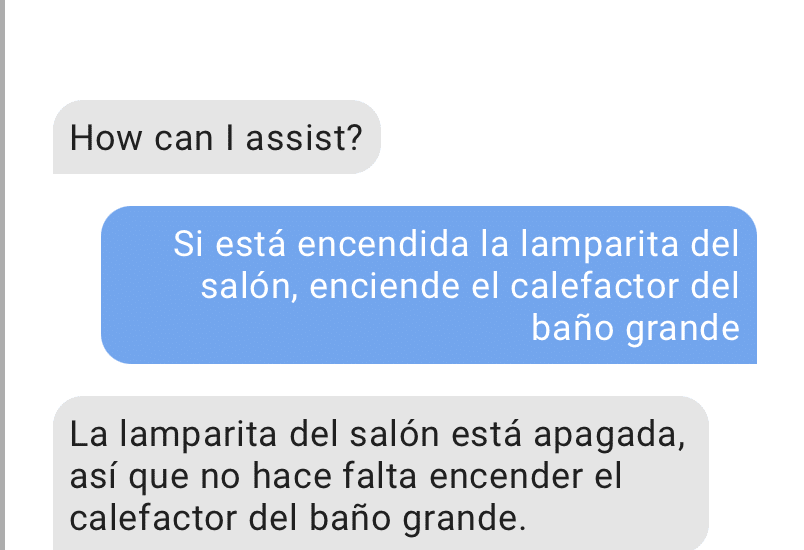

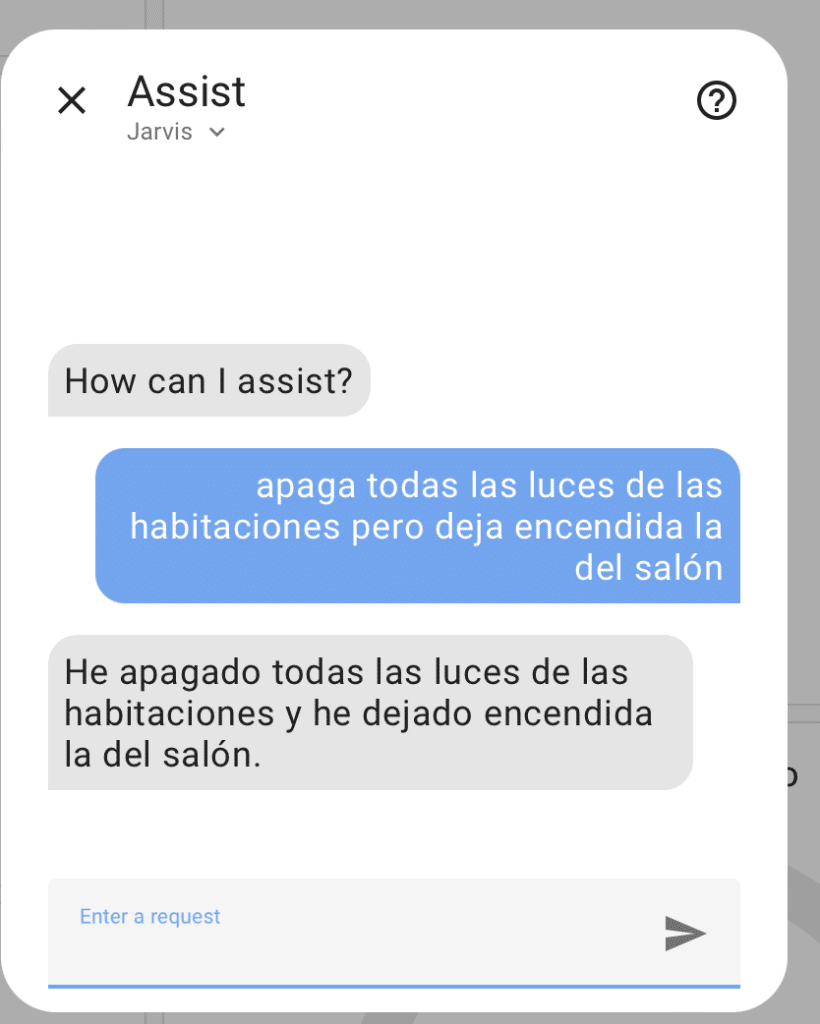

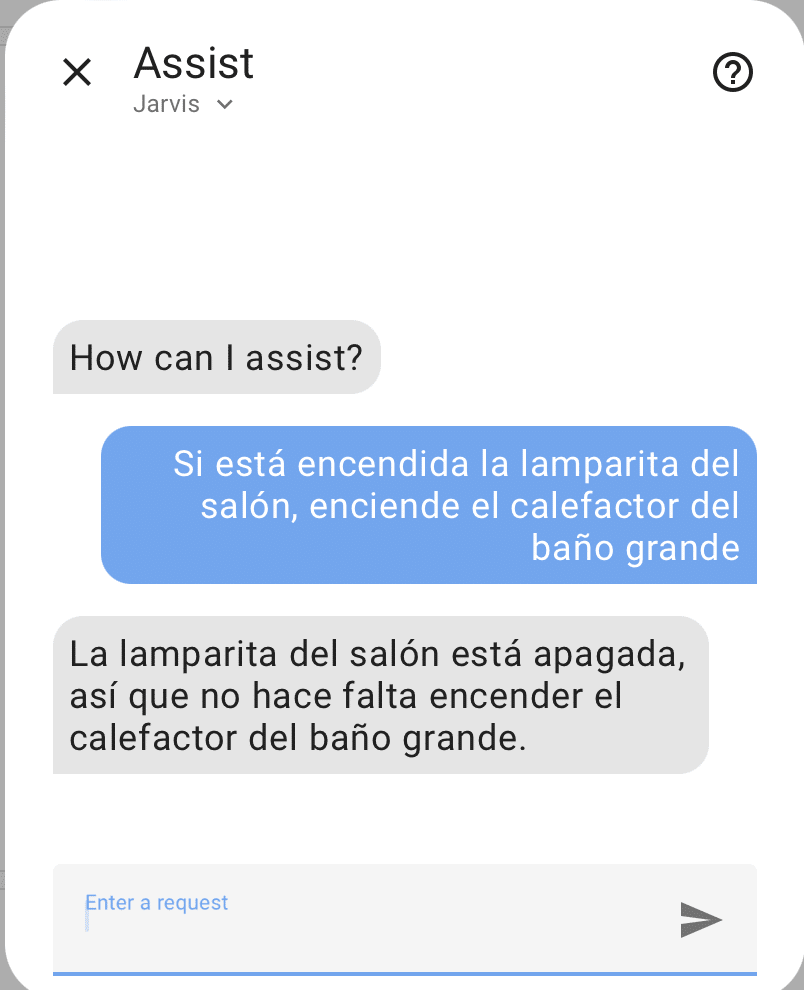

Podemos decirle por ejemplo ‘Hey Jarvis, apaga todas las luces de las habitaciones pero deja encendida la del salón’, esa parte de enlazar acciones lo hace de maravilla. También podemos darle una condición compleja de la forma ‘Hey Jarvis, si está la luz del baño encendida y hace menos de 20 grados en el salón, enciende el calefactor del baño pequeño’. Además, podemos pedirle por ejemplo que cree una nueva automatización ‘Hey Jarvis, si la lamparita del salón está apagada a las 20:30 y hay alguien en casa, enciéndela, por favor.’ Y, si estamos utilizando la integración oficial con ChatGPT, nos dice: ‘No tengo la capacidad de realizar acciones automatizadas basadas en la hora y la presencia. Necesitarías crear una automatización en Home Assistant para eso. ¿Quieres que simplemente encienda la lamparita del salón ahora?.’

Pero si estamos utilizando el Extended Conversation de HACS, añadirá esa automatización sin problemas: La lamparita del salón se encenderá a las 20:30 si hay alguien en casa.

Por supuesto que podemos entablar conversación con Jarvis y preguntarle cosas como ‘Están las luces del encendidas?’ Y si nos dice que sí le podemos decir ‘Ok pues apágalas, por favor’ esto mola muchísimo, pero depende del dispositivo que utilices va mejor o peor… en mi caso desde el Mac parece que ‘corta’ las conversaciones cuando me contesta, por lo que no puedes mantener una conversación o enlazar un segundo comando, pero desde el iPhone sí que me funciona bien. Tendré que investigar un poco.

También le podemos decir expresiones como ‘Hey Jarvis, el salón está un poco oscuro’ y encenderá las luces sin preguntar nada más… o le puedes dar acceso a la base de datos de Home Assistant y preguntarle cómo estaba la luz del salón a las 3 de la mañana. No os parece una pasada?

Además, Como ya sabéis que Home Assistant soporta la integración con un montón de dispositivos, hay algunos ejemplos por ahí que hacen que te vuele la cabeza. He visto a un usuario que le decía ‘Quiero ver el Juego del Calamar’ y directamente le encendía la televisión y lo buscaba en Netflix. También puedes tener tu Calendario o tu lista de la compra sincronizados con Home Assistant, por lo que le puedes pedir cosas más típicas como ‘Añade leche a la lista de la compra’ o preguntarle si tienes eventos en el calendario para el día siguiente. Todo muy loco… aunque ya os digo que la peña por ahí está chaladísima, he visto un tío con una cámara en la cocina enfocando a la despensa y OpenAI es capaz de detectar el nivel de legumbres que tiene en los botes transparentes que se ven en la imagen y añadir a la lista de la compra ‘Comprar lentejas’ cuando baja de cierto nivel. Todo muy loco.

Os podéis imaginar que estoy como un niño con zapatos nuevos pidiéndole todas las jilipolleces y chorradas que se me ocurren y viendo cómo puedo integrar más cosas. Por ejemplo, nunca me había planteado integrar el tiempo, el weather, no los minutos, en Home Assistant… me parecía una tontería porque lo llevo en el móvil, en el reloj, en el ordenador, se lo puedo preguntar a Siri… pues ahora tiene más sentido ya que puedo crear una automatización que me diga por los altavoces si va a llover en los próximos minutos y le pueda decir ‘Ah pues recoge el toldo, por favor’ todo con la voz tal y como os lo estoy contando a vosotros.

El único inconveniente que tiene esto es que la API de OpenAI cuesta dinero para este tipo de integraciones. Lo que hago yo es poner un presupuesto máximo (que en mi caso son 20€ al mes) y si en algún momento llega ahí… pues me quedo sin poder charlar con mi colega la casa, qué le vamos a hacer, pero todos los dispositivos seguirán funcionando sin problemas. Os tengo que decir que no he llegado nunca a esos 20€ al mes… y eso que estoy todo el santo día liado con Jarvis, casi hablo con el asistente más que con mi mujer…

La verdad es que con la Inteligencia Artificial me pasa una cosa que no me pasaba desde hace años… me apasionan las posibilidades, por primera vez creo que el límite sí que está en la imaginación y no en la tecnología. Pero lo dicho, imaginad las posibilidades que abre esto para invidentes, ya que muchos de ellos me contratan una Consultoría Domótica para automatizar algunas acciones como apagado de luces, notificaciones con puertas abiertas y cosas así… pues de esta forma se pueden crear las notificaciones directamente con la voz y responder directamente por los altavoces para que la casa actúe en consecuencia.

¿Y a qué dispositivo le hablas para disparar el asistente? Alguna clase de altavoz con micrófono?